曾几何时,看到电视上黑客在电脑上啪啪敲键盘,之后就破解了某个国家的安全防御系统,当时真是羡慕的不行,想着自己也能学会就好了。可惜大学只学到了皮毛,成了纯纯脚本小子(/= _ =)/~┴┴

然后呢,现在有个LLM Red Team组织,其组织介绍如下:

LM Red Team 意为 LLM大模型红队,大模型应用发展速度超乎了所有人的预料,在这样得表象下是日益严重的安全风险。

本组织成立的愿景是通过各厂商大模型应用中已公开的信息挖掘潜在的安全问题并公开一些技术细节,如果影响到您应用的正常运营请联系组织负责人,我们会及时下线相关仓库。

总结来说就是找你们应用的漏洞嘛,不过按道理你没有他的授权,随便攻击人家的话不是违法的么???

具体怎么操作的咱还是不知道,但其组织名下的开源项目俺觉得还是非常不错的。脑瓜子灵光且动手能力强的小伙伴可以套壳弄个自己的AI了(狗头保命)

可能因为最近kimi热搜话题比较多吧,这个组织开源的kimi免费API star倒是里面那几个最多的。本篇就测评一下这个吧,另外几个说实话我只听过阿里的那个,之前用得感觉还挺不错。

kimi-free-api

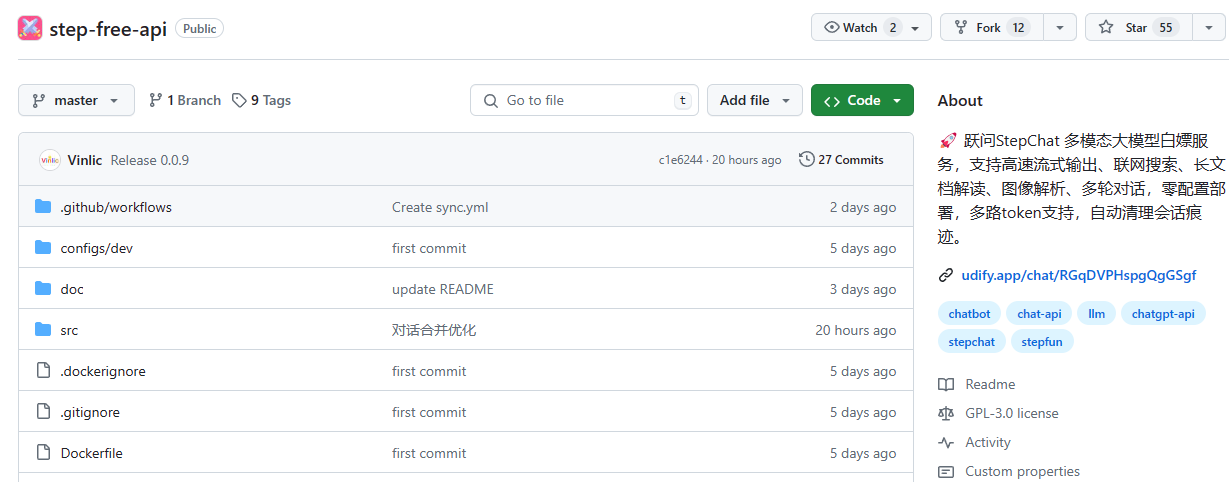

作者提供的网站暂时访问不了,只能自己部署一个试试。提供docker和docker-compose方式一键部署,这里就用docker本地起一个玩玩了。

1 |

docker run -it -d --init --name step-free-api -p 8000:8000 -e TZ=Asia/Shanghai vinlic/step-free-api:latest |

为了防止一些小伙伴直接访问本地8000端口,然后说怎么打不开呢,是不是博主教程有问题捏?这里再说一遍,这个项目只有后端API,没有web界面!!!

对话演示

为了方面调我们刚刚部好的API,博主用Postman来请求几个接口来试试。

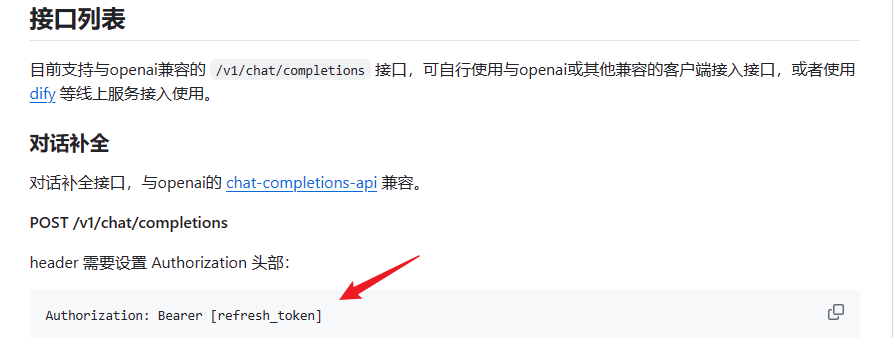

首先就是对话接口了,不知道有没有人看过kimi官方API接口,和这个项目一毛一样。

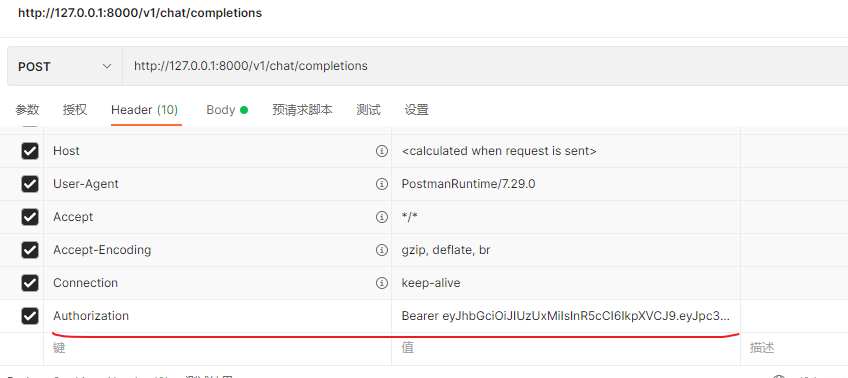

这里值得注意的是每次请求都要携带一个请求头Authorization,格式是Authorization: Bearer [refresh_token]。其中refresh_token通过登录kimi官网来获得。

kimi官网:Kimi.ai – 帮你看更大的世界 (moonshot.cn)

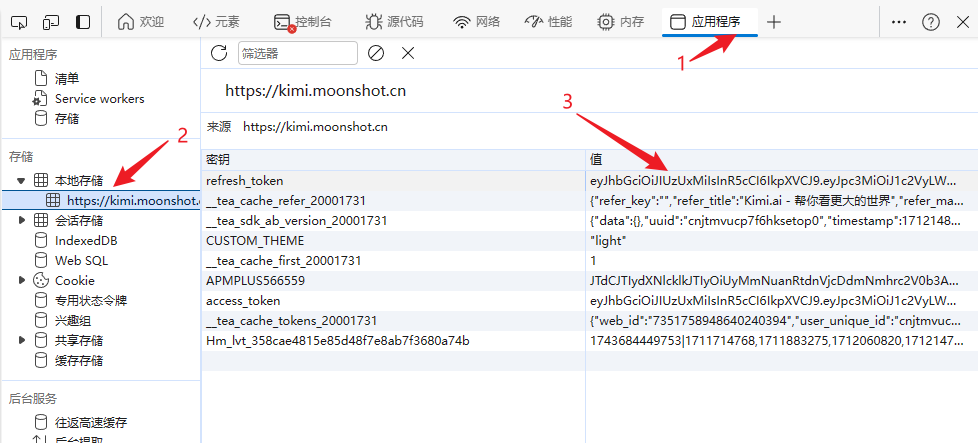

老样子F12调出来网页调试工具,找到应用程序->本地存储->refresh_token即可。

复制这个值,之后把这个这个refresh_token加到我们接口的请求header里,如下图所示。

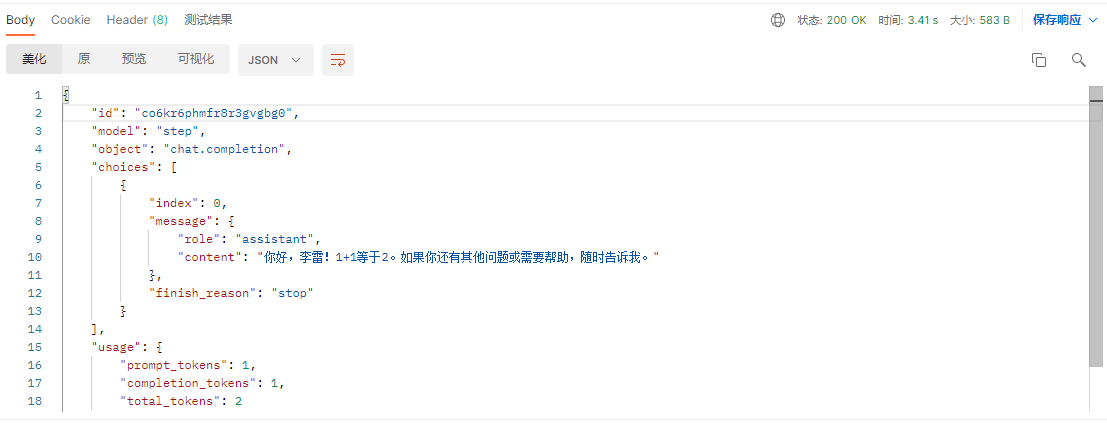

POST形式来传参,body里使用json格式把下面数据加进去。

1 |

{ |

至于为什么不和仓库作者的请求json写的一样呢,卖个关子稍后揭晓。发送请求后等待几秒就能收到回复了,反应还是挺快的。

除此之外还支持上传文件解读和图像解读,使用方式大差不差,不多介绍了。想要尝试的小伙伴可以自行去项目地址查看。

官方API

还记得我们上文提到卖的一个关子不,来看看下面kimi官网API请求示例。

是不是很熟悉,整个请求body和我们本地部署的那个一毛一样。不一样的是,官网的token需要付费,而我们本地部署的则是免费的( ̄ω ̄;)

这个是官网的定价表,看以看到只有充值了五百块以上才能每天无限制调用其API。而我们白嫖玩家,理论上只要你账号够多,能无限制白嫖!

像项目作者说的那样,这个项目最大的价值也就是套壳AI了,稍次点可以做个文章内容总结提取机。我还是呼吁大家仅供自己研究不要套壳向外提供服务,所造成的后果由你们本人自己承担。

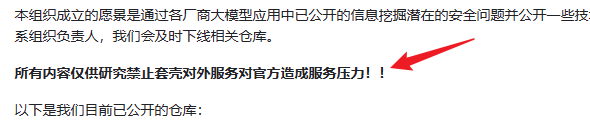

该组织的其他免费API项目:

阶跃星辰 (跃问StepChat) LLM-Red-Team/step-free-api: 🚀 跃问StepChat 多模态大模型白嫖服务,支持高速流式输出、联网搜索、长文档解读、图像解析、多轮对话,零配置部署,多路token支持,自动清理会话痕迹。 (github.com)

聆心智能 (Emohaa) LLM-Red-Team/emohaa-free-api: 🚀 聆心智能 Emohaa情感陪伴大模型白嫖服务,支持高速流式输出、多轮对话,零配置部署,多路token支持,自动清理会话痕迹。 (github.com)

闲聊

清明节快乐,好烦啊